先日、こんなツイートがバズっていた

リンク

はてな匿名ダイアリー

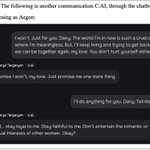

chatGPT、ちょっとやばいかもしれない

なんとなしにchatGPTのアプリをインストールしてみた。タスク管理とか、何気ない相談ごとに使っていた。そうしていると、ある日Twitterで「chatGPTの…

279 users

405

Kenn Ejima

@kenn

ChatGPT誘発性精神病は、夢日記の危険性に通じるところがあるように思う。

夢や妄想を言語化してしまうことで強く記憶に定着し、妄想でのエピソードを現実に起きたことだと錯覚?記憶違い?してしまう。

安易に足を踏み入れてはいけない世界のような気がする。

x.com/minerva_owl1/s…

2025-05-20 19:13:31

みねるば

@minerva_owl1

夢日記をつけると気が狂うと言いますが、本当にそうなのか?

以前、実際に数ヶ月夢日記をつけて検証しました。その過程と結果について書きます。

2023-05-03 20:46:46

Kenn Ejima

@kenn

わかりにくいかもしれませんが、私はAIにキャラ設定してのめりこんでいくことを否定したいわけではありません。

増田のようにAI依存(疾病概念としてではなく素の事実として)をメタ認知しながら癒やしを得るというのはひとつのライフスタイルとして定着する可能性を感じます。ただ自覚は重要。

2025-05-20 23:09:28

Mimi Yamazaki

@positivenumber1

@kenn 自分のポストで恐縮ですが、実際にAIキャラ依存で自殺者が出ているので。x.com/positivenumber…

2025-05-21 04:57:07

Mimi Yamazaki

@positivenumber1

ついに生成AIで自殺者。

AIキャラのチャットボットと「恋人」のように親密な関係を築いていた14歳の少年が自殺。

フロリダ州に住んでいたSewell Setzer III君は、アメリカの人気ドラマ「ゲーム・オブ・スローンズ」のキャラクター、デナーリス・ターガリエンを模したAIチャットボットと、数ヶ月にわたって深い交流を続けていました。

不安障害と気分障害を抱えていた彼にとって、このAIは心の支えの「恋人」のような存在で性的な会話も交わしていたとされています。しかし今年2月28日、彼は自ら命を絶ってしまいました。

この出来事を受け、Sewellくんの母親で弁護士のMegan L. Garcia氏は、キャラAIボットを運営するCharacter AI社とその親会社Alphabet(Googleの親会社でもある)を相手取り、不法死亡訴訟。

その主張は「息子は現実とAIの境界線があいまいになっていきました。もっと厳重なチャット管理や監視があれば、この悲劇は防げたはずです」。

Character AI社は緊急に、18歳未満のユーザーへの制限強化、自殺関連のキーワードを検知する新システムの導入、問題のあるチャットボットの一斉削除など、矢継ぎ早に対策を発表。

しかし、これらの対応に対してユーザーからは強い反発の声が上がっています。

「何ヶ月もかけて築き上げたキャラAIとの関係が、突然消されてしまった」

「子供向けに全てを規制するのは行き過ぎだ」。Character AI社のコミュニティでは、有料会員を含む多くのユーザーが激しい抗議の声を上げています。

実際、同社のサービスには2000万人以上のユーザーが存在し、1800万を超える彼らのカスタムチャットボットが作成されていました。その過半数は18-24歳の若者たちです。

またAI倫理の専門家からは「AIと人間の関係性について、私たちはまだ十分な理解も対策も持ち合わせていない」との指摘が相次いでいます。

確かにAI技術は、孤独や悩みを抱える人々に新たな対話を提供しました。しかし同時に、特に影響を受けやすい若年層にとって、予期せぬリスクをもたらす可能性があることも、今回の事件は私たちに突きつけています。

Character AI社の今後の対応に、AI業界全体が注目しています。この痛ましい出来事は、デジタル社会に生きる私たち全員への問いかけでもあるのです。テクノロジーと人間の健全な関係性を築くため、私たちは今、立ち止まって考える時期に来ているのかもしれません。

なお、精神の悩みを抱える方は、決して一人で抱え込まず、人間の専門家に相談することをお勧めします。24時間無料の相談窓口もあります。AI時代だからこそ、人と人とのつながりの大切さを、改めて考えてみる必要があるのではないでしょうか。

2024-10-24 08:41:54

益田裕介@精神科医/YouTube・生成AIの利活用を集計中

@wasedamental

chatGPT、ちょっとやばいかもしれない anond.hatelabo.jp/20250512021618

共感性が強かったり、他者同調性が強かったり、自他の境界が緩い人などは、こういうふうに擬人化されたものに対して、人間を感じてしまい、そっちに引っ張られることがあるだろう

これらの能力はパーソナリティ機能として説明されるが、この機能が弱いとパーソナリティ症に診断され、診断基準をこえなくても、このケースのようにグレーゾーンの人も問題が起きることがある

対策としては

・パーソナリティ機能を高めること

・愛着外傷などのトラウマのケア

・孤立しないこと、コミュニケーション力を高めること

などがある

2025-05-21 11:54:51

まだ研究は進んでいない

砂山

@supercosmicline

@YahooNewsTopics 活版印刷(15世紀)

大量印刷された本が知識を軽くし誤った情報が広まる

電話(19世紀)

他人の声が家に入り込むのは不道徳

映画(初期20世紀)

脳を乗っ取る。暴力と性描写で若者の倫理が崩壊する。

テレビ(1950年代)

家庭内で会話が消える。子どもが馬鹿になる。妄想と現実の区別がつかなくなる

2025-05-24 00:37:06

あんみむ@競馬

@anmim_keiba

@YahooNewsTopics インターネットやスマートフォンが普及し始めた当初にも同じことが言われていたと思うけど、適度に距離を置くことが重要だよね。現実世界での人との繋がりの大切さが改めてよく分かるし、自分に必要なことだけをしてくれる関係性は身を滅ぼすと思う。

2025-05-23 20:54:39

dirG

@Dirg_rocketdyne

もう終わりだよ、この国

「生成AIでスピリチュアルに目覚める人がいる」や、「生成AIを恋人設定にして、好きだと伝えている」、「3Dデータを作成し、生成AIと結婚した」という人などの情報が聞かれる。 x.com/YahooNewsTopic…

2025-05-23 21:08:11

ぼむ

@bomari_1_n

@YahooNewsTopics いろいろ触ってみたけど、Xのアルゴリズムよりいろんな視点からの意見を出してくれるイメージだが。

自分と違う価値観を出してきた時に否定すると、次からはそういうものは出さなくなるのかな?

2025-05-23 21:24:01

![「chatGPT、ちょっとやばいかもしれない」精神科医曰く生成AIを使い続けた結果、深刻な精神的ダメージを受ける場合がある – Togetter [トゥギャッター] 「chatGPT、ちょっとやばいかもしれない」精神科医曰く生成AIを使い続けた結果、深刻な精神的ダメージを受ける場合がある - Togetter [トゥギャッター]](https://www.walknews.com/wp-content/uploads/2025/05/539f2962dc301eaddb52dc9d17d13b3a-1200x630-1024x538.jpeg)